ライセンス通知

このコードベースおよび関連するモデルの重みは FISH AUDIO RESEARCH LICENSE の下でリリースされています。詳細は LICENSE を参照してください。

法的免責事項

私たちは、コードベースのいかなる違法な使用に対しても責任を負いません。DMCA およびその他の関連法に関する現地の規制を参照してください。

クイックスタート

まずはドキュメントから

Fish Audio S2 の公式ドキュメントです。以下からすぐに始められます。

[!IMPORTANT] SGLang サーバーについては SGLang-Omni README を参照してください。

LLM Agent 向け

Fish Audio S2

オープンソースおよびクローズドソースの中で最も優れたテキスト読み上げシステム

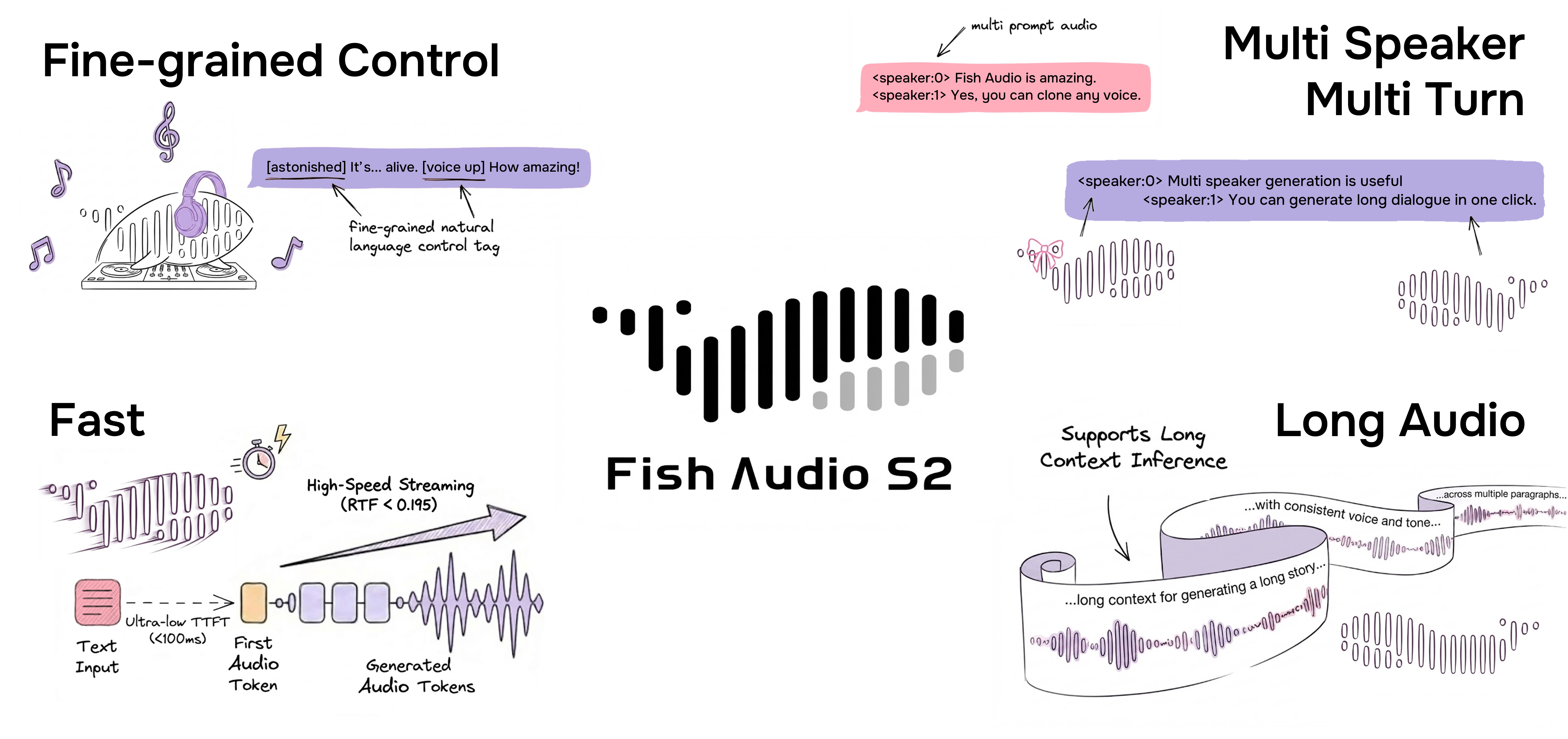

Fish Audio S2 は Fish Audio が開発した最新モデルです。約 50 言語・1,000 万時間超の音声データで学習され、強化学習アラインメントと Dual-Autoregressive アーキテクチャを組み合わせることで、自然でリアルかつ感情表現豊かな音声を生成します。

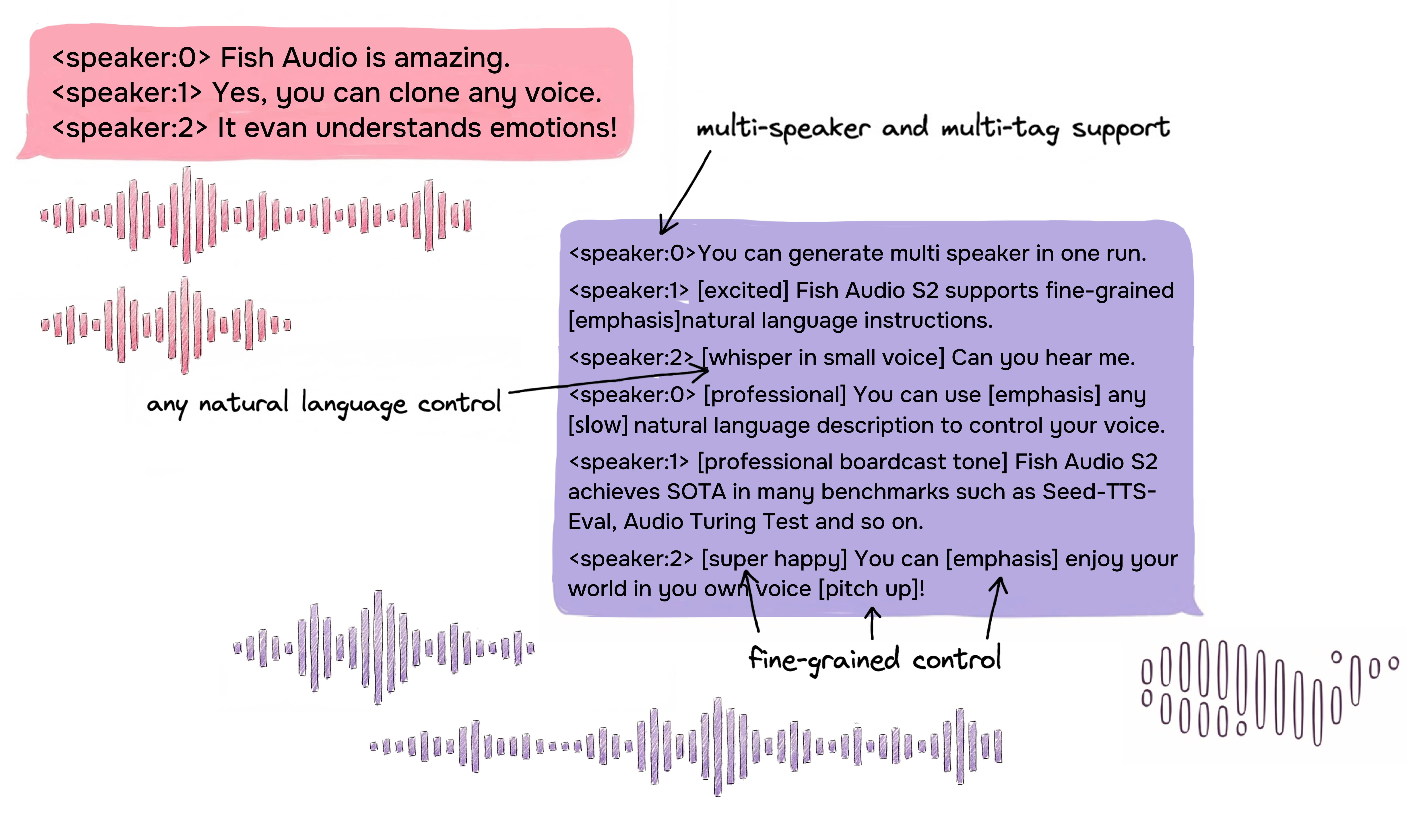

S2 は [laugh]、[whispers]、[super happy] といった自然言語タグで、韻律や感情を文中の任意位置で細かく制御できます。さらに、マルチスピーカー生成とマルチターン生成にもネイティブ対応しています。

ライブデモは Fish Audio ウェブサイト から、詳細は ブログ記事 と 技術レポート をご覧ください。

モデルバリアント

| モデル | サイズ | 利用可能性 | 説明 |

|---|---|---|---|

| S2-Pro | 4B パラメータ | HuggingFace | 品質と安定性を最大化したフル機能のフラッグシップモデル |

モデルの詳細は技術レポートをご参照ください。

ベンチマーク結果

| ベンチマーク | Fish Audio S2 |

|---|---|

| Seed-TTS Eval — WER(中国語) | 0.54%(全体最良) |

| Seed-TTS Eval — WER(英語) | 0.99%(全体最良) |

| Audio Turing Test(指示あり) | 0.515 事後平均値 |

| EmergentTTS-Eval — 勝率 | 81.88%(全体最高) |

| Fish Instruction Benchmark — TAR | 93.3% |

| Fish Instruction Benchmark — 品質 | 4.51 / 5.0 |

| 多言語(MiniMax Testset)— 最良 WER | 24 言語中 11 言語 |

| 多言語(MiniMax Testset)— 最良 SIM | 24 言語中 17 言語 |

Seed-TTS Eval では、S2 はクローズドソースを含む全評価モデルの中で最小 WER を達成しました:Qwen3-TTS(0.77/1.24)、MiniMax Speech-02(0.99/1.90)、Seed-TTS(1.12/2.25)。Audio Turing Test では 0.515 を記録し、Seed-TTS(0.417)比で 24%、MiniMax-Speech(0.387)比で 33% 上回りました。EmergentTTS-Eval では、副言語情報(91.61%)、疑問文(84.41%)、統語的複雑性(83.39%)で特に高い成績を示しています。

ハイライト

自然言語による細粒度インライン制御

Fish Audio S2 では、テキスト内の特定の単語やフレーズ位置に自然言語の指示を直接埋め込むことで、音声生成を局所的に制御できます。固定の事前定義タグに依存するのではなく、S2 は [whisper in small voice]、[professional broadcast tone]、[pitch up] のような自由形式のテキスト記述を受け付け、単語レベルで表現をオープンエンドに制御できます。

二重自己回帰(Dual-Autoregressive)アーキテクチャ

S2 はデコーダー専用 Transformer と RVQ ベースの音声コーデック(10 codebooks、約 21 Hz)を組み合わせています。Dual-AR は生成を 2 段階に分割します。

- Slow AR は時間軸方向に動作し、主となる semantic codebook を予測。

- Fast AR は各時刻で残り 9 個の residual codebook を生成し、細かな音響ディテールを復元。

この非対称設計(時間軸 4B パラメータ、深さ軸 400M パラメータ)により、音質を保ちながら推論効率を高めています。

強化学習アラインメント

S2 は後学習アラインメントに Group Relative Policy Optimization(GRPO)を採用しています。学習データのフィルタリングとアノテーションに使った同一モデル群を、そのまま RL の報酬モデルとして再利用することで、事前学習データ分布と事後学習目的のミスマッチを抑制しています。報酬信号には、意味的正確性、指示追従性、音響的選好スコア、音色類似度が含まれます。

SGLang による本番向けストリーミング

Dual-AR は構造的に標準的な自己回帰 LLM と同型のため、S2 は SGLang の LLM 向け最適化をそのまま活用できます。たとえば continuous batching、paged KV cache、CUDA graph replay、RadixAttention ベースの prefix caching です。

単一の NVIDIA H200 GPU での実測:

- RTF(Real-Time Factor): 0.195

- 初回音声出力までの時間: 約 100 ms

- スループット: RTF 0.5 未満を維持しつつ 3,000+ acoustic tokens/s

多言語サポート

Fish Audio S2 は、音素や言語固有の前処理を必要とせずに、高品質な多言語テキスト読み上げをサポートします。以下を含みます:

英語、中国語、日本語、韓国語、アラビア語、ドイツ語、フランス語...

さらに多く!

リストは常に拡大しています。最新のリリースについては Fish Audio を確認してください。

ネイティブなマルチスピーカー生成

Fish Audio S2 では、ユーザーが複数のスピーカーを含む参照オーディオをアップロードでき、モデルは <|speaker:i|> トークンを介して各スピーカーの特徴を処理します。その後、スピーカーIDトークンを使用してモデルのパフォーマンスを制御し、1回の生成で複数のスピーカーを含めることができます。以前のように各スピーカーに対して個別に参照オーディオをアップロードして音声を生成する必要はもうありません。

マルチターン対話生成

モデルのコンテキストの拡張により、以前の情報を使用して後続の生成されたコンテンツの表現力を向上させ、コンテンツの自然さを高めることができるようになりました。

高速音声クローニング

Fish Audio S2 は、短い参照サンプル(通常10〜30秒)を使用した正確な音声クローニングをサポートしています。モデルは音色、話し方、感情的な傾向を捉え、追加の微調整なしでリアルで一貫したクローン音声を生成します。 SGLang サーバーの利用については SGLang-Omni README を参照してください。

クレジット

技術レポート

@misc{fish-speech-v1.4,

title={Fish-Speech: Leveraging Large Language Models for Advanced Multilingual Text-to-Speech Synthesis},

author={Shijia Liao and Yuxuan Wang and Tianyu Li and Yifan Cheng and Ruoyi Zhang and Rongzhi Zhou and Yijin Xing},

year={2024},

eprint={2411.01156},

archivePrefix={arXiv},

primaryClass={cs.SD},

url={https://arxiv.org/abs/2411.01156},

}

@misc{liao2026fishaudios2technical,

title={Fish Audio S2 Technical Report},

author={Shijia Liao and Yuxuan Wang and Songting Liu and Yifan Cheng and Ruoyi Zhang and Tianyu Li and Shidong Li and Yisheng Zheng and Xingwei Liu and Qingzheng Wang and Zhizhuo Zhou and Jiahua Liu and Xin Chen and Dawei Han},

year={2026},

eprint={2603.08823},

archivePrefix={arXiv},

primaryClass={cs.SD},

url={https://arxiv.org/abs/2603.08823},

}